Badania nad interfejsem mózg-komputer (BCI) rozpoczęto w latach

70-tych XX wieku na Uniwersytecie Kalofornijskim w Los Angeles. Za pierwszą publikację naukową

opisującą BCI można uznać pracę: Jacque Vidala [149]: "Toward Direct

Brain-Computer Communication", Annual Review of Biophysics and

Bioengineering, Vol. 2, 1973. Pierwsza międzynarodowa konferencja poświęcona

BCI miała miejsce w 1999 roku, w Nowym Jorku, gdzie Jonathan R. Wolpaw podał

definicję interfejsu mózg-komputer: "A brain-computer interface (BCI)

is a communication or control system in which the user’s messages or commands

do not depend on the brain’s normal output channels. That is, the message is

not carried by nerves and muscles, and, furthermore, neuromuscular activity is

not needed to produce the activity that does carry the message".

W ostatniej dekadzie ubiegłego wieku, w kilkunastu ośrodkach

naukowych, rozpoczęto intensywne prace nad systemami BCI. Aktualny stan badań

sprowadza się do wykorzystania pewnych właściwości fal elektromagnetycznych

mózgu rejestrowanych za pomocą technik elektroencefalograficznych (sygnały EEG

odczytane z elektrod przymocowanych do skóry głowy). W systemie BCI intencje

użytkownika odczytywane są bezpośrednio z fal EEG. Pewne, wyekstrahowane cechy

tych fal (sygnałów) są klasyfikowane i „tłumaczone” w czasie rzeczywistym na

rozkazy wykorzystywane do sterowania komputerem, protezą, wózkiem inwalidzkim

lub też innym urządzeniem. Schemat najważniejszych etapów działania interfejsu

mózg-komputer przedstawiono na rys. 2.4.

Rys

2. 1. Zasada pracy interfejsu mózg-komputer

Warto pamiętać, że systemy BCI funkcjonują również pod nazwą

interfejs mózg-maszyna (Brain-Machine

Interface - BMI). Jednak najczęściej w literaturze spotyka się określenie

„interfejs mózg-komputer”. Spowodowane jest to faktem, że nawet podczas

sterowania robotem, wózkiem inwalidzkim czy protezą zwykle korzysta się z

pośrednictwa komputera. Komputer jest tutaj nieodzownym elementem, którego

zadaniem jest przetwarzanie i klasyfikacja sygnału. To właśnie ten etap

jest krytycznym elementem działania interfejsu i od niego zależy w dużej

mierze jego sprawność.

Istnieje wiele metod badania aktywności mózgu. Najbardziej znane

są metody

inwazyjne:

·

implantowane

elektrody domózgowe (IntraCortical Recordings, IR),

częściowo inwazyjne:

·

elektrokortykografia, (Electrocorticography, ECoG),

nieinwazyjne:

·

magnetoencefalografia, (Magnetoencephalography, MEG),

·

funkcjonalny magnetyczny rezonans jądrowy (functional Magnetic Resonance Imaging,

fMRI),

·

tomografia optyczna światła rozproszonego (Near InfraRed Spectroscopy, NIRS),

·

pozytronowa emisyjna tomografia komputerowa (Positron emission tomography,

PET),

·

elektroencefalografia (Electroencefalography, EEG).

Jednak, jak już wspomniano, najczęściej wykorzystywaną techniką

w systemach BCI jest elektroencefalografia (EEG). Spowodowane jest to kilkoma

czynnikami. Po pierwsze MEG, PET, fMRI i metody optyczne są stosunkowo drogie.

Dodatkowo metody te są skomplikowane pod względem technicznym i stąd nie znajdą

zastosowania w urządzeniach powszechnego użytku. Metody obrazowe, z kolei,

charakteryzują się lepszą lokalizacją aktywności mózgu, ale aktywność ta jest

zależna od przepływu krwi, który charakteryzuje się dużą stałą czasową i

uniemożliwia szybką komunikację [152]. Do największych zalet

elektroencefalografii, w zastosowaniu do BCI należą: ocena aktywności mózgu

występującej dokładnie w chwili rejestracji sygnału, praca w wielu warunkach

środowiskowych, niski koszt realizacji w porównaniu z innymi metodami. Bardzo

znaczącym atutem elektroencefalografii jest stosunkowa łatwość w użytkowaniu.

Po krótkim przeszkoleniu użytkownika może być stosowana w warunkach domowych.

Do zebrania sygnału EEG wykorzystywane są elektrody (od kilku do

128 elektrod) naklejane na skórę głowy za pomocą żelu. Następnie sygnał

przekazywany jest do elektroencefalografu, gdzie sygnały są wzmocnione i w

postaci cyfrowej przekazywane do komputera. Zapis tych sygnałów tworzy tak

zwany elektroencefalogram.

Rejestrowane sygnały pochodzą ze zbiorowej aktywności neuronów i

są efektem tzw. pomiaru biologicznego. Przy pomiarze technicznym badacz ma

świadomość, że wyznaczany parametr obiektywnie istnieje, a niedokładności jego

określenia wynikają z niedoskonałości metody i aparatury pomiarowej. W biologii i medycynie samo mierzone zjawisko

często nie jest do końca zdefiniowane. Ponadto, na pomiar składa się wiele

czynników ubocznych, które niejednokrotnie mają ogromny wpływ na wynik pomiaru.

Dlatego pojedyncza obserwacja nie jest miarodajna. Wszystkie eksperymenty i

obserwacje medyczne muszą odnosić się do zbiorowości, a obserwacje trzeba

powtarzać wielokrotnie [144]. Stąd też wynika zasadnicza trudność w

konstruowaniu sprawnych interfejsów mózg-komputer.

Z pomocą przychodzi statystyczne uczenie maszynowe (statistical

machine learning) oraz techniki eksploracji danych (data-mining). To dzięki tym metodom

można wydobyć użyteczną informację z sygnału EEG i poddać ją klasyfikacji. Jak

pokazano na rysunku 2.6 przetwarzanie sygnału obejmuje: przetwarzanie wstępne,

ekstrakcję cech (w procesie eksperymentu i nauki także selekcję cech) oraz

klasyfikację. Zadania te realizowane są przy pomocy komputera, w czasie

rzeczywistym.

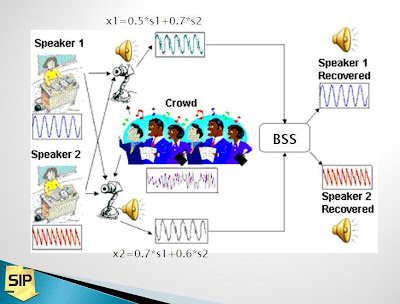

Przetwarzanie wstępne najczęściej obejmuje filtrację sygnału i

inne metody usuwania szumów i zakłóceń (np. artefaktów fizjologicznych). Na tym

etapie wykorzystywane są: filtry cyfrowe, filtry przestrzenne, metody

wybielania sygnału (np. analiza składowych niezależnych - ICA) czy ślepa

separacja. Po tym etapie otrzymuje się sygnały, z których można dokonywać

ekstrakcji cech.

Ekstrakcja cech jest procesem, który umożliwia wydobycie z

zapisu EEG najbardziej użytecznych informacji. Stosuje się całą gamę metod

analizy sygnału na przykład: statystyki wyższych rzędów (HOS), analizę

czas-częstotliwość (t/f), modele autoregresyjne (AR), analizę falkową (DWT). W

wyniku ekstrakcji powstają wektory cech. Dysponując wiedzą o przynależności

cech do danej klasy można przystąpić do budowy (i trenowania) klasyfikatora.

Zadaniem klasyfikatora jest przydzielenie nowo zarejestrowanego

zapisu EEG do konkretnej, uprzednio zdefiniowanej klasy. Najczęściej na tym

etapie wykorzystuje się sztuczne sieci neuronowe (ANN), liniową analizę

dyskryminacyjną (LDA), naiwny klasyfikator Bayesa (NBC), maszynę wektorów

wspierających (SVM) oraz drzewa decyzyjne (DT).

Sklasyfikowane sygnały EEG wykorzystywane są najczęściej do

sterowania wirtualną klawiaturą (komunikacja z otoczeniem za pośrednictwem

tekstu). Podejmowane są również próby stosowania systemów BCI do sterowania

robotem, protezą, a nawet inteligentnym budynkiem. Warto zauważyć, że obiekty

sterowane przez interfejsy mózg-komputer mogą mieć wbudowaną „własną inteligencję”.

Na przykład wózek inwalidzki lub robot ma wbudowane czujniki i elementy

wykonawcze, które nie pozwalają na zderzenie z przeszkodą.

Bardzo ważnym elementem pełnego systemu BCI jest sprzężenie

zwrotne (feedback). Użytkownik

interfejsu mózg-komputer nieustannie obserwuje efekty swoich działań poprzez

obserwację działania wirtualnej klawiatury, protezy czy robota. Pomaga mu to

wygenerować nowe, odpowiednie sygnały EEG. Jest to jeden z ważnych elementów

systemu, bowiem niektóre interfejsy wymagają świadomego generowania konkretnych

stanów mózgu. Poprzez obserwację efektów użytkownik może uczyć się lepszej

kontroli nad aktywnością własnego mózgu.